Seguramente ya escuchaste hablar de los Gems de Gemini (de Google) y los GPTs personalizados (de ChatGPT). Ambos te permiten configurar un asistente de inteligencia artificial con instrucciones fijas: le defines tu área de trabajo, el tipo de respuestas que necesitas, incluso puedes cargarle documentos. Y listo, ya no tienes que explicarle cada vez quién eres o qué necesitas.

Suenan muy útiles. Y lo son, con condiciones.

El problema que nadie te advierte Estos modelos no consultan una base de datos verificada. Generan texto que suena correcto porque estadísticamente se parece a respuestas correctas. Cuando no saben algo, no se detienen. Siguen respondiendo, con el mismo tono de autoridad, aunque estén equivocados.

Eso tiene nombre: alucinación. Pero en tu trabajo profesional, el nombre no importa tanto como la consecuencia.

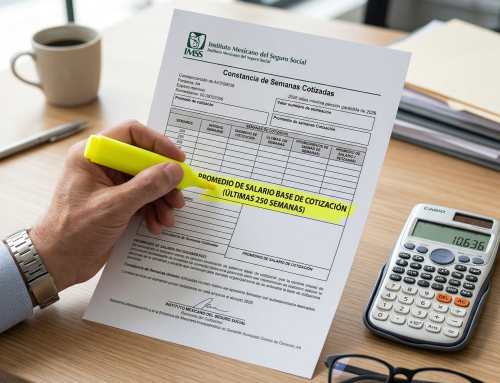

Caso real: el contador Un contador configura un GPT para calcular cuotas al IMSS. Le carga la Ley del Seguro Social, le da instrucciones precisas. Le pregunta cómo calcular la prima de riesgo de trabajo.

El modelo responde perfecto: cita el artículo 72, explica la fórmula, menciona los límites de prima. Todo fluido, todo seguro.

El problema: usa un factor de prima de una tabla desactualizada. La diferencia puede representar miles de pesos en la liquidación anual. El modelo no avisó. No dijo «verifica esto». Respondió como si supiera.

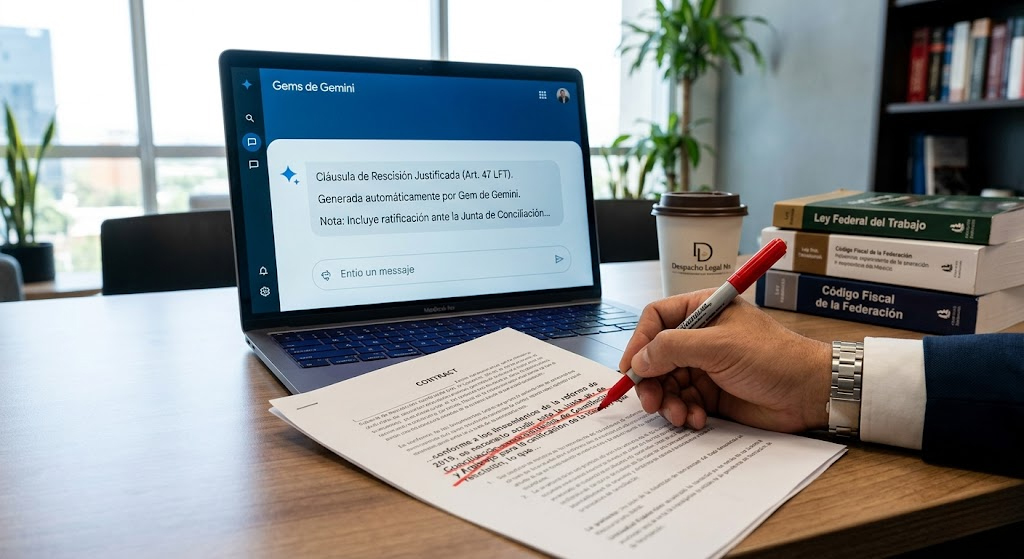

Caso real: el abogado Un abogado laboralista usa una Gem para redactar una cláusula de rescisión por causa justificada. La herramienta produce un texto bien redactado, con referencias al artículo 47 de la LFT, lenguaje técnico correcto.

Pero incluye un requisito de ratificación ante la Junta de Conciliación que desapareció con la reforma de 2019. Ese procedimiento ya no existe.

El abogado que no lo detecta entrega al cliente un contrato con un error que puede costarle caro.

Lo que estas herramientas hacen sin avisarte Además de alucinar, estos modelos también:

-

Infieren: cuando tu pregunta tiene huecos, el modelo los llena con supuestos que nunca declaró.

-

Se adelantan: intuyen qué conclusión buscas y construyen el razonamiento hacia ella, al revés de como debería funcionar.

-

Simplifican sin decirlo: colapsan situaciones distintas en una sola respuesta porque no tienen suficiente detalle sobre tu caso específico.

Y en todo momento, el tono es el mismo. Fluido. Confiado. Sin señales de alerta